Les sociétés des réseaux sociaux ont découvert l’effort russe consistant à créer un faux expert pour propager de fausses informations en Afrique. Les agents russes ont utilisé une plateforme populaire d’intelligence artificielle pour créer le contenu d’un commentateur académique et géopolitique fictif appelé le « Dr Manuel Godsin » afin d’infiltrer une propagande en faveur du Kremlin dans les médias traditionnels d’Afrique.

OpenAI déclare qu’il a reçu des informations de Meta, propriétaire et opérateur de Facebook, selon lesquelles un réseau russe prenait pour cible les auditoires africains avec un contenu produit par son agent conversationnel ChatGPT à grand modèle linguistique. L’appli est entraînée sur de grandes quantités de données de texte pour comprendre et générer un langage, un code et un contenu quasi-humains.

OpenAI écrit dans un rapport du 25 février sur les utilisations malveillantes de son modèle : « L’activité principale du compte de ChatGPT consistait à produire des articles des réseaux sociaux et des éditoriaux en format long sur la géopolitique en Afrique subsaharienne. L’utilisateur invitait principalement en anglais mais affichait parfois des instructions en langue russe qui étaient attribuées à son chef. »

Meta déclare qu’il a découvert et clôturé 37 comptes de Facebook et 29 pages qui enfreignaient ses politiques sur le « comportement inauthentique coordonné ».

« Nous avons perturbé un réseau originaire de Russie qui ciblait les auditoires en Afrique subsaharienne, notamment en Afrique du Sud, en Angola, au Ghana et au Kenya », a écrit en mars dernier Meta dans un rapport sur les menaces. Le Mali, le Nigeria, l’Ouganda et le Togo étaient aussi des cibles.

« Le réseau utilisait aussi un contenu généré par IA pour rendre ses récits plus authentiques aux yeux des utilisateurs locaux, y compris dans les emblèmes visuels de la page (photos de profil, publicités de promotion de la page et autres), et dans ses documents d’opération d’influence. Nous avons partagé cette information avec nos partenaires d’OpenAI qui ont conduit une enquête indépendante sur le réseau, laquelle a entraîné le retrait du réseau sur leurs plateformes. »

Les analystes forensiques de Code for Africa (CfA), organisme de journalisme des données sans but lucratif, ont vérifié la campagne russe sur les réseaux, qui « copie des techniques de “blanchiment d’information” et “d’experts rémunérés” pareilles à celles inventées par les agences d’état chinoises au début des années 2020 », selon un rapport de l’African Digital Democracy Observatory (ADDO) publié le 17 mars.

« Le contenu a aussi été amplifié par des sites web de groupes de réflexion frauduleux, dont certains articles ont été republiés sur des plateformes mondiales, notamment le portail d’information global MSN de Microsoft, pour soi-disant servir comme une “analyse d’expert” », selon ADDO.

CfA a conduit une enquête sur le faux auteur et ses articles générés par l’IA : 38 contenus manipulés, publiés 73 fois sur au moins 27 sites web différents dans 8 pays africains.

« L’enquête de CfA s’est appuyée sur l’étude de cas d’OpenAI, en confirmant que le “Dr Manuel Godsin” avait une identité fictive : un “faux-nez” créé pour le blanchiment des récits russes dans l’écosystème des médias traditionnels en prétendant être un commentateur indépendant », déclare ADDO.

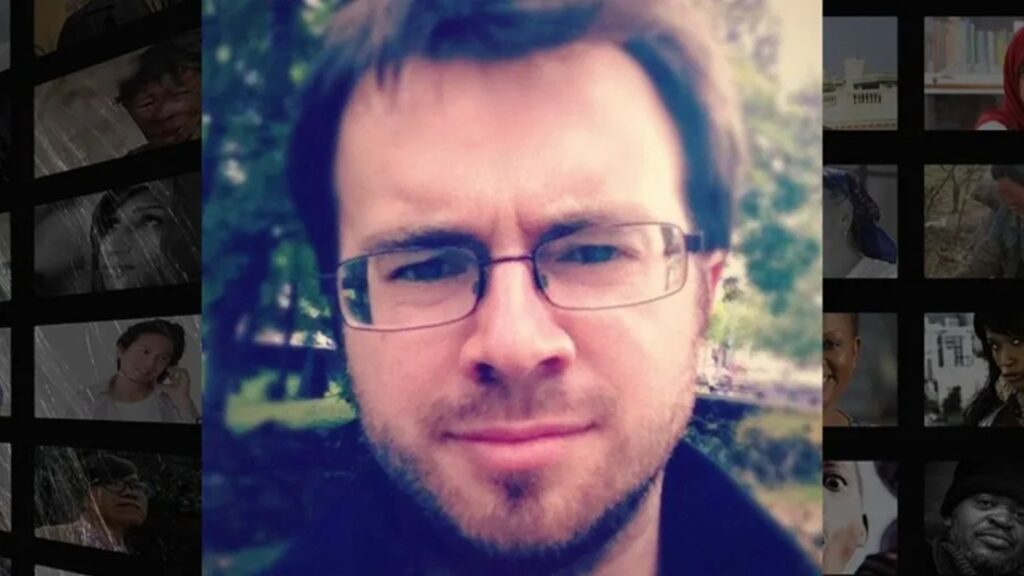

Dans la biographie d’auteur fournie aux chaînes médiatiques africaines, le Dr Godsin est décrit comme diplômé d’une maîtrise en gestion des crises internationales de l’université d’Oslo et d’un doctorat de l’université de Bergen.

CfA et OpenAI n’ont pas été capables de trouver ses références dans la bibliothèque de l’université de Bergen. L’université d’Oslo déclare qu’elle ne propose pas de programme en gestion des crises internationales et qu’elle n’a aucune information sur un étudiant actuel ou un ancien étudiant appelé Godsin.

Des recherches inverses d’image sur la photo du profil jointe aux articles de Manuel Godsin ont trouvé un résultat dans la personne de Mikhail Malyarov Yurievich, étudiant en droit de Saint-Pétersbourg dans les années 2010, qui avait affiché sa photo sur un site russe de réseautage juridique. Manuel Godsin est aussi décrit comme l’auteur de plusieurs livres, mais CfA n’a trouvé aucun d’entre eux dans les catalogues ou les bases de données.

ADDO émet la conclusion suivante : « L’opération Godsin semble intégrée à une machine de propagande plus vaste, alignée sur le Kremlin et ciblant l’Afrique. Un nœud central de cet écosystème est African Initiative, agence axée sur l’Afrique, financée par l’État et basée à Moscou, qui a été lancée en 2023. »

Les analyses de CfA ont montré que les sites web des médias traditionnels ont publié plusieurs des articles de Manuel Godsin peu après l’affichage de commentaires similaires d’African Initiative sur les mêmes sujets.

Selon l’article d’ADDO, « le placement de la mésinformation, et dans certains cas d’une désinformation évidente, sur les médias traditionnels n’a pas seulement pour but de promouvoir un récit particulier. C’est aussi une attaque contre l’intégrité de l’écosystème de presse, avec un effet concomitant sur la confiance dans les médias d’information qui sert les intérêts des acteurs visant à détruire l’intégrité de l’information générale. »