Le Ghana est réputé pour ses antécédents solides de gouvernement civil, son adhésion aux principes démocratiques et son engagement international, dans la région et dans le monde. Il représente une île de stabilité en Afrique de l’Ouest, région confrontée par les coups d’État militaires et l’extrémisme violent.

Toutefois, il n’est pas immunisé contre certains des facteurs de stress auxquels font face ses voisins, en particulier en ce qui concerne la désinformation. Les agents influents malveillants ont lancé au moins 72 campagnes pour obfusquer, déformer et distordre la réalité en Afrique de l’Ouest, selon un rapport du Centre d’études stratégiques de l’Afrique (CESA) en date de mars 2024. Le Ghana est victime d’au moins cinq de ces efforts, perpétrés par la Chine, la Russie, des acteurs politiques nationaux et autres.

Kojo Oppong Nkrumah, ministre de l’Information du Ghana à l’époque, avait déclaré au site nigérian FactCheckHub à la fin 2023 : « Avec le développement des médias, il existe aujourd’hui de multiples chaînes médiatiques dans tout le pays, et nous en sommes très fiers. Le risque est donc que les informations qui manquent d’intégrité se retrouvent dans le domaine public : c’est cela qui susciterait la mésinformation/désinformation. »

Harriet Ofori, qui conduit un suivi de la désinformation en tant que directrice de recherche et de projet à l’organisme ghanéen sans but lucratif Penplusbytes, a déclaré que ce dernier œuvre avec les médias, les institutions universitaires, l’Unesco, la Commission nationale pour l’éducation civique et d’autres sur une vaste gamme de projets et d’initiatives. Elle se souvient d’une campagne de désinformation particulièrement dangereuse.

« En juillet 2023, un message audio faisant appel à des attaques contre le gouvernement ghanéen pour son rapatriement forcé des demandeurs d’asile peuls a été propagé par WhatsApp dans le Nord du Ghana, dit-elle à ADF dans un e-mail. Le message prétendait faussement que le gouvernement essayait d’exterminer la population peul et encourageait les représailles. Il était diffusé par une antenne médiatique du Groupe de soutien à l’islam et aux musulmans (GSIM). »

À mesure que la désinformation propagée par les organisations extrémistes violentes, les laquais russes et les intérêts chinois s’intensifie à un taux presque exponentiel, certains pays africains augmentent leurs efforts visant à inciter le continent à écouter la vérité. C’est une tâche herculéenne qui exige des mécanismes de détection extraordinaires, des systèmes d’alerte précoce et une collaboration robuste entre les groupes de la société civile, les gouvernements, les médias et les forces de sécurité.

Le Ghana et son voisin, la Côte d’Ivoire, se distinguent sur ce point. En décembre 2023, le Ghana a conçu un plan d’action national pour affronter la désinformation. Il s’est manifesté à la suite d’une conférence nationale sur la désinformation et la mésinformation, et il a été élaboré par les partis politiques, les groupes de la société civile, les médias et les partenaires de développement, selon FactCheckHub. Lorsqu’il sera approuvé, le plan d’action cherchera à protéger l’intégrité de l’information, encourager la maîtrise médiatique et favoriser la responsabilité numérique citoyenne.

Penplusbytes a aussi collaboré avec le gouvernement ghanéen. Il a conduit des recherches sur la désinformation avec l’appui de l’Héritage national pour la démocratie, puis il a engagé les officiels, notamment au ministère de l’Information, pour mettre en commun les résultats des recherches et discuter des recommandations pour combattre la désinformation, alors que la nation élabore son plan d’action, déclare Harriet Ofori.

À l’Ouest du Ghana, la Côte d’Ivoire aide le public à prendre conscience des dangers de la désinformation. Amadou Coulibaly, ministre de la Communication et de l’Économie numérique, a déclaré aux résidents de la communauté d’Adjamé à Abidjan en juillet 2024 que, lorsqu’ils diffusent de fausses informations sur les réseaux sociaux, ils deviennent des « sorciers du numérique », selon le site web ivoirien d’actualité Koaci.com. Son discours s’inscrit dans le cadre de la campagne nationale appelée #EnLigneTousResponsables.

UN NOUVEL OUTIL APPARAÎT

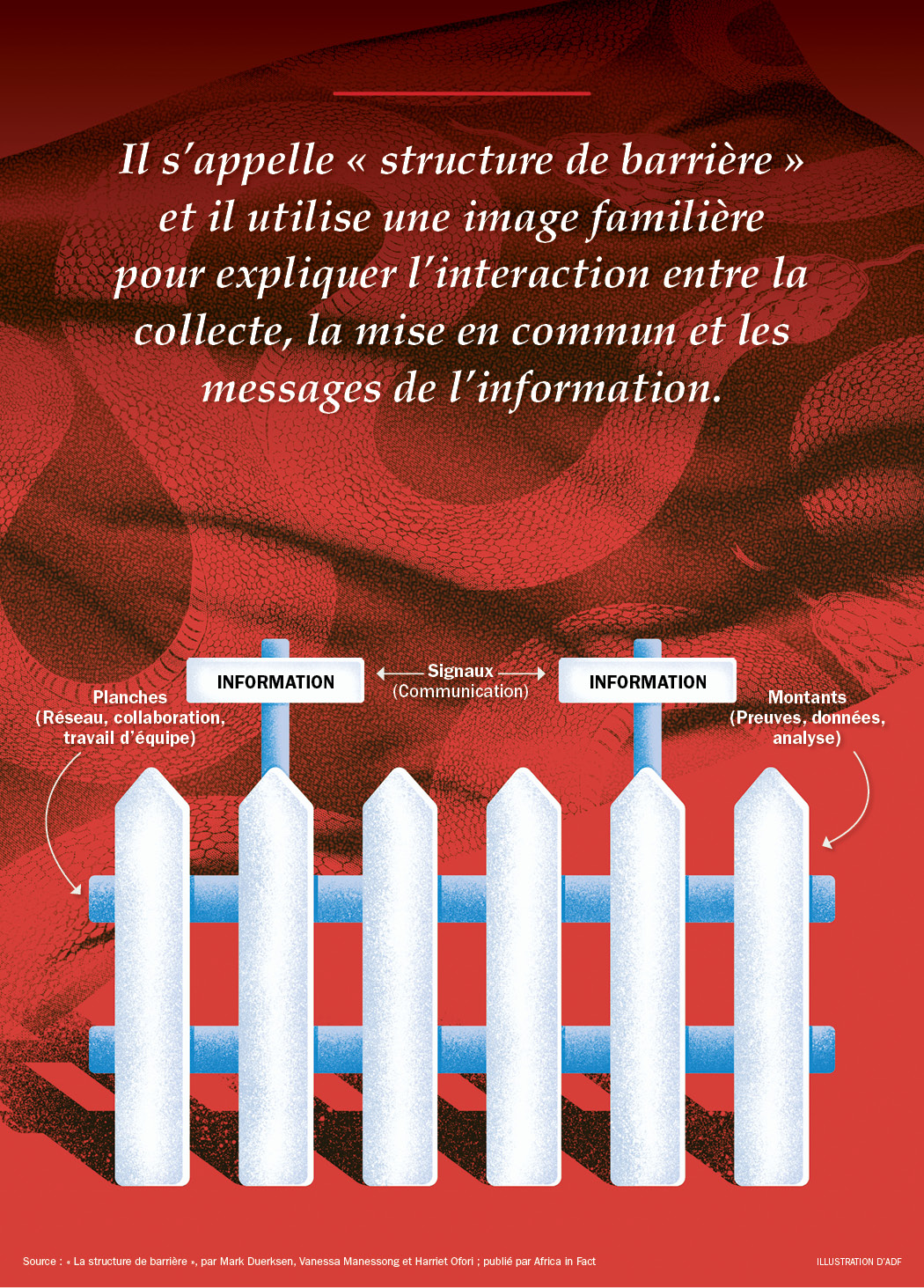

Alors que la désinformation continue à croître, un nouveau processus vise à détecter la menace et à l’inverser dans le panorama de communication de l’Afrique. Il s’appelle « structure de barrière » et utilise une image familière pour expliquer l’interaction entre la collecte, la mise en commun et les messages de l’information.

Le « défi consiste à créer des “parasurtenseurs” (ce que nous pouvons appeler tout simplement des “barrières”) pour bloquer la désinformation et responsabiliser les internautes afin qu’ils se protègent eux-mêmes contre les interférences manipulatrices », écrivent le Dr Mark Duerksen, associé de recherche auprès du CESA, Vanessa Manessong, analyste investigatrice de données chez Code for Africa au Cameroun, et Harriet Ofori. Ces trois auteurs ont publié un article intitulé « The fence framework » (la structure de barrière) sur le site web Africa in Fact en juillet 2024.

Le motif de la barrière, avec ses représentations de montants, planches et signaux, illustre comment faire face à la désinformation de façon coordonnée. Lorsque les trois éléments travaillent ensemble, les répondants peuvent identifier et classer la désinformation, et y répondre efficacement.

MONTANTS : LES DONNÉES

Dans l’illustration de la barrière, les montants sont la fondation de la réponse. Ils représentent les données que possèdent les répondants sur la désinformation. La structure ABCDE pose alors une série de questions cruciales : Quels sont les acteurs qui participent ? Quel est le comportement démontré ? Quel type de contenu est diffusé ? Quel est le degré de diffusion et quels sont les auditoires pris pour cible ? Quel est l’effet d’ensemble de la désinformation ?

Les universitaires, les journalistes, les adeptes du fact-checking, les organisations non gouvernementales, divers groupes de la société civile et les forces de sécurité peuvent recueillir ce type de données. La collecte offre des informations sur les campagnes qui deviennent virales ou provoquent les plus grands dangers immédiats de l’environnement informationnel. Quels sont les récit particuliers qui sont propagés ? Les malfaiteurs utilisent-ils de simples techniques couper/coller sur les réseaux sociaux, ou des techniques plus sophistiquées ? Toutes ces informations sont réunies pour former une image utile dans le deuxième élément de la structure.

PLANCHES : LA COOPÉRATION

Les planches connectent les montants entre eux et les réunissent. Les planches représentent la coopération qui aide les gens à partager et bien comprendre les données qu’ils collectent sur la désinformation propagée.

« Les recherches sur les campagnes de désinformation doivent être échangeables et interprétables par les praticiens pour avoir un impact », précise l’article. Pour ce faire, on s’appuie sur des normes établies, une terminologie commune, les réseaux et la collaboration pour que les informations puissent être partagées de façon fiable entre les gens et les agences qui doivent les connaître.

La terminologie, la compréhension et les approches mises en commun permettront à l’ONG d’un pays de communiquer avec une organisation de fact-checking médiatique d’un autre pays au sujet des menaces qu’elle constate. On espère que, grâce à ce processus, une plus grande image émergera sur la nature de la campagne de désinformation et ceux qui la diffusent. Puisque la désinformation transcende les frontières nationales, ce type de collaboration est essentiel.

Un centre de partage et d’analyse de l’information (ISAC) est un outil de collaboration utile. Cette vision consiste à avoir un réseau de plusieurs ISAC sur le continent, servant de plateformes pour analyser et contrer la désinformation. En date de la mi-2024, il n’y avait pas d’ISAC en Afrique, mais le groupe de réflexion anti-désinformation lituanien indépendant Debunk.org a un financement pour établir un ISAC à Kinshasa (République démocratique du Congo).

SIGNAUX : LA RÉPONSE

Une fois que les données sont recueillies, organisées, analysées et partagées, une réponse appropriée peut commencer. C’est la composante des signaux de la structure de barrière. Les données et les relations doivent œuvrer « vers un objectif, que ce soit une campagne de sensibilisation où vous essayez simplement de fournir des informations sur ce qui se passe, vous approchez certaines plateformes de réseaux sociaux pour leur dire ce qui se passe, vous essayez de travailler avec elles pour éliminer un certain contenu ou bloquer ou supprimer certains de ces réseaux de bots », déclare le Dr Duerksen à ADF.

C’est la phase pendant laquelle les responsables avertissent le public de l’existence des campagnes actives de désinformation. Elle peut inclure la réfutation des mauvaises informations avec de bons messages ou la mention aux plateformes d’information que des forces hostiles les utilisent pour propager la désinformation. Ce type de communication et de développement des capacités peut aussi se produire avant la diffusion de la désinformation.

« Votre réponse essaie de développer la maîtrise du numérique dans la société, pour en sorte aider les gens à bien comprendre que ces attaques se produisent », déclare le Dr Duerksen. Faire cela avant une attaque peut parfois prévenir la désinformation.

LE RÔLE DES FORCES DE SÉCURITÉ

Pour lutter contre la désinformation, la coopération entre plusieurs agences et intérêts est essentielle. Les forces armées ont un rôle à jouer. La désinformation est une préoccupation légitime du secteur sécuritaire parce qu’elle représente une forme de guerre hybride et peut provoquer une menace réelle et tangible pour les soldats, y compris les gardiens de la paix, qui agissent dans des lieux où abondent les messages toxiques. C’était le cas pour la mission de maintien de la paix des Nations unies en RDC.

Dans cette mission, la désinformation et la mésinformation étaient une menace constante, qui poussait les responsables à bâtir ce qu’ils appelaient une « armée numérique » pour combattre le problème. Grâce à cette stratégie, la mission responsabilisait les civils, et en particulier les jeunes, pour détecter les actualités et les articles de réseaux sociaux malveillants et pour y répondre avec des informations exactes.

Bintou Keita, représentante spéciale des Nations unies pour la RDC et chef de la mission de maintien de la paix de l’ONU dans ce pays, a déclaré dans une interview de 2023 avec UN News que les groupes armés propagent délibérément des mensonges pour inciter les gens à opposer la mission.

Elle a dit à UN News : « Pour vous en donner simplement un exemple, pendant que la session de haut niveau de l’Assemblée générale avait lieu, j’étais à Kinshasa lorsque quelqu’un décida de créer des infox en utilisant une photo de moi qui datait je crois de trois ans auparavant, lorsque j’étais secrétaire générale adjointe pour l’Afrique à New York [au siège social de l’ONU], avec un texte qui disait essentiellement que, en tant que chef [de mission], je m’opposais au départ de la mission. C’était faux parce que, en premier lieu, je n’étais pas à l’Assemblée générale, j’étais à Kinshasa. »

« Nous avons eu une discussion : quoi faire, dire que c’est une infox ? Quoi faire en fin de compte ? Je crois que mes collègues ont décidé comme suit : d’accord, c’est une infox, et c’est parti comme ça. »

Les forces armées et les forces de sécurité ont souvent plus de ressources et d’expertise technique que leurs partenaires civils, mais elles doivent faire attention lorsqu’elles agissent dans l’environnement informationnel public. En fait, il y a de bonnes raisons pour que l’armée ne dirige pas du tout ces efforts.

Parfois, les citoyens ne font pas confiance aux forces armées de leur pays. Si celles-ci commencent à dire aux gens quelles sont les informations qui sont bonnes et quelles sont celles qui ne le sont pas, cela peut susciter le scepticisme et saper les tentatives légitimes pour combattre la désinformation.

C’est pourquoi les journalistes, les praticiens du fact-checking et les chercheurs pourraient être de meilleurs messagers de première ligne pour les populations civiles, en particulier s’ils sont des sources de confiance, comme les radiodiffuseurs ou les reporters locaux.

Pourtant, déclare le Dr Duerksen, les forces armées doivent être sensibilisées et rester informées du « rythme » de l’environnement informationnel où elles sont actives en surveillant la radio locale et les réseaux sociaux. De cette façon, elles peuvent assurer le suivi des faux récits et les signaler aux journalistes et agents influents locaux. Ce qu’elles ne devraient pas faire, c’est d’être vues comme essayant d’influencer les plateformes publiques ou de diffuser elles-mêmes des informations.

Le Dr Duerksen dit : « Donc, lorsque vous constatez ce genre de choses, à qui vous référez-vous ? À qui vous adressez-vous ? Qui est le meilleur porte-parole pour cela ? Qui est en meilleure position pour y répondre ? Très probablement, ce n’est pas l’armée. »

DÉFINITIONS

La DÉSINFORMATION est fausse et fabriquée pour nuire intentionnellement aux gens, aux groupes sociaux, aux organisations ou au pays. Un exemple consiste à propager une fausse rumeur selon laquelle les forces de sécurité fournissent des armes aux terroristes.

La MÉSINFORMATION est également fausse mais elle n’a pas d’intention délibérée de nuire. Par exemple, les chefs communautaires pourraient propager accidentellement une affirmation fausse qu’ils croient être vraie.

L’INFORMATION MALVEILLANTE, bien qu’elle soit basée sur la réalité, est utilisée pour nuire. Elle pourrait inclure l’information dévoilée qui aurait dû rester privée. Elle peut aussi inclure le discours haineux.

Source : « Le désordre de l’information : vers une structure interdisciplinaire pour la recherche et l’adoption des politiques », 2017, par le Dr Claire Wardle et Hossein Derakhshan

LES DANGERS DU DEEPFAKE

PERSONNEL D’ADF

Alors que la technologie de l’intelligence artificielle (IA) continue à se développer, les responsables africains devront faire attention à un outil de désinformation particulièrement insidieux : le deepfake.

Le deepfake est une forme de média numérique créé par des outils IA qui peuvent être utilisés pour manipuler les photos, l’audio et les vidéos. Ceci peut être dangereux parce qu’il peut être employé pour créer des médias qui prétendent montrer un personnage politique ou une célébrité qui dit ou fait des choses qu’il ne dirait pas ou ne ferait pas normalement.

Les attaques de désinformation qui incluent le deepfake posent un autre problème : certaines applications logicielles, gratuites et téléchargeables, peuvent les rendre suffisamment faciles à créer par presque tout le monde.

Les conséquences de leur utilisation par les terroristes et les organisations extrémistes violentes sont calamiteuses.

« Un scénario futur pourrait inclure des bots automatisés propageant des vidéos deepfake incitant les manifestations ou la violence, qui sont diffusées rapidement sur de multiples plateformes, chacune personnalisée pour adresser des sous-groupes spécifiques », selon un article de 2024 par Lidia Bernd intitulé « La déception aidée par l’IA : la nouvelle arène du contre-terrorisme » pour Georgetown Security Studies Review.

Les gouvernements, les sociétés de technologie et les institutions universitaires devront œuvrer ensemble pour développer et actualiser constamment des outils axés sur l’IA afin de détecter le deepfake, écrit-elle.

La chercheuse sud-africaine Layckan Van Gensen, maître de conférences junior du droit mercantile à l’université Stellenbosch, encourage l’adoption de lois pour protéger le droit à l’image de façon à combattre le deepfake. Elle a écrit pour le journal Daily Nation que la législation du droit à l’image définirait clairement l’image d’une personne, spécifierait dans quelles circonstances cette image est enfreinte, et fournirait au détenteur de l’image des réparations judiciaires pour un emploi non autorisé.